Wenn Spotify Tracks finden muss, die dem ähneln, was Sie gerade hören, kann es sich nicht nur auf Tags und Metadaten verlassen. Es analysiert die Roh-Audiodaten selbst.

Dieser Leitfaden erklärt, wie Spotify Audio-Merkmale aus Musikdateien extrahiert, was diese Merkmale bedeuten und wie sie beeinflussen, wo Ihre Tracks in algorithmischen Playlists erscheinen.

Wie die Audioanalyse bei Spotify funktioniert

Wenn ein Track über einen Distributor bei Spotify hochgeladen wird, durchläuft er eine automatisierte Audioanalyse-Pipeline. Das System verarbeitet die Roh-Wellenform und extrahiert Dutzende messbare Eigenschaften.

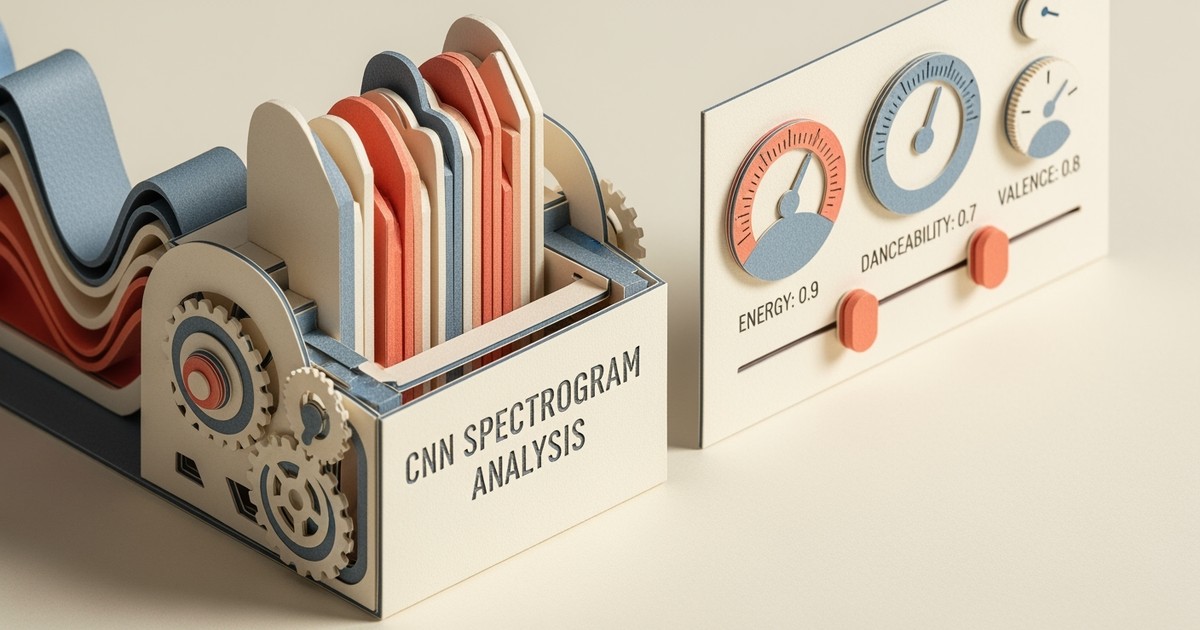

Die Kerntechnologie sind Convolutional Neural Networks (CNNs), dieselbe Art von Machine-Learning-Modellen, die zur Bilderkennung verwendet werden. Anstatt Pixel zu analysieren, analysieren die CNNs von Spotify Spektrogramme, also visuelle Darstellungen von Schallfrequenzen über die Zeit.

Das CNN lernt, Muster in diesen Spektrogrammen zu erkennen: starke Schlagzeug-Beats und Synthesizer deuten auf elektronische oder Dance-Musik hin; sanfte Akustikgitarrenmuster weisen auf Folk oder Singer-Songwriter-Genres hin; komplexe harmonische Strukturen könnten auf Jazz oder Klassik hindeuten.

Die von Spotify extrahierten Audio-Merkmale

Die Spotify API stellt für jeden Track 13 Audio-Merkmale bereit. Dies sind die Bausteine, mit denen der Algorithmus die klangliche Ähnlichkeit misst.

Rhythmus- und Tempo-Merkmale

| Feature | Definition | Range |

|---|---|---|

tempo |

Geschätzte Beats pro Minute (BPM) | 0-250 |

time_signature |

Beats pro Takt (3/4, 4/4, etc.) | 1-7 |

danceability |

Wie gut zum Tanzen geeignet, basierend auf Tempo, Rhythmusstabilität, Beatstärke | 0.0-1.0 |

Danceability ist nicht nur das Tempo. Ein Track mit 120 BPM mit unregelmäßigen Rhythmen erzielt einen niedrigeren Wert als ein Track mit 100 BPM mit einem gleichmäßigen Groove.

Energie- und Intensitätsmerkmale

| Feature | Definition | Range |

|---|---|---|

energy |

Wahrgenommene Messung von Intensität und Aktivität | 0.0-1.0 |

loudness |

Gesamtlautstärke in Dezibel (dB) | -60 bis 0 dB |

Energy kombiniert mehrere Signale: Dynamikbereich, wahrgenommene Lautstärke, Timbre, Anschlagsrate (wie oft neue Klänge beginnen) und allgemeine Entropie. Death Metal erzielt hohe Werte; ein Bach-Präludium erzielt niedrige Werte.

Tonale Merkmale

| Feature | Definition | Range |

|---|---|---|

key |

Das tonale Zentrum des Tracks | 0-11 (C=0, C#=1, etc.) |

mode |

Dur (1) oder Moll (0) | 0 oder 1 |

Diese Merkmale helfen dem Algorithmus, Tracks mit kompatiblen harmonischen Strukturen für nahtlose Übergänge in Radio und Autoplay zu gruppieren.

Stimmungs- und Charaktermerkmale

| Feature | Definition | Range |

|---|---|---|

valence |

Musikalische Positivität (fröhlich vs. traurig) | 0.0-1.0 |

acousticness |

Vertrauen, dass der Track akustisch ist | 0.0-1.0 |

instrumentalness |

Vorhersage, ob der Track keine Vocals hat | 0.0-1.0 |

speechiness |

Anwesenheit von gesprochenen Worten | 0.0-1.0 |

liveness |

Wahrscheinlichkeit, dass der Track live aufgeführt wurde | 0.0-1.0 |

Valence ist besonders wichtig für stimmungsbasierte Empfehlungen. Ein Track mit hoher Valence (0.8+) klingt fröhlich oder euphorisch. Ein Track mit niedriger Valence (0.2 oder darunter) klingt traurig, melancholisch oder wütend.

Wie Audio-Merkmale Empfehlungen beeinflussen

Die Audioanalyse löst das Kaltstartproblem. Wenn ein neuer Künstler seinen ersten Track hochlädt, hat er keine Hörhistorie oder Daten zum kollaborativen Filtern. Aber die Audio-Merkmale sind sofort verfügbar.

Hier erfahren Sie, wie jede algorithmische Oberfläche Audioanalyse nutzt:

Radio und Autoplay

Wenn Radio eine Warteschlange basierend auf einem Seed-Track generiert, ist die klangliche Ähnlichkeit das primäre Signal. Der Algorithmus findet Tracks mit ähnlichem:

- Tempo (in einem angemessenen Bereich für reibungslose Übergänge)

- Energieniveau (um die Intensität der Session beizubehalten)

- Tonart und Modus (für harmonische Kompatibilität)

- Valence (um den emotionalen Ton beizubehalten)

Deshalb wird eine Radiostation, die von einem energiegeladenen elektronischen Track ausgeht, nicht plötzlich eine langsame Akustikballade einfügen, auch wenn beide Songs Genre-Tags teilen.

Discover Weekly

Discover Weekly nutzt hauptsächlich kollaboratives Filtern, aber die Audioanalyse dient als Tiebreaker. Wenn mehrere Kandidatentracks ähnliche Überlappungswerte beim Hören aufweisen, bevorzugt der Algorithmus diejenigen, deren Audio-Merkmale seinem bestehenden Geschmacksprofil am nächsten kommen.

Was Künstler aus Audio-Merkmalen lernen können

Sie können nicht direkt steuern, wie Spotify Ihre Audiodaten analysiert, aber das Verständnis dieser Merkmale hilft Ihnen zu interpretieren, wie der Algorithmus Ihre Musik wahrnimmt.

Überprüfung der Audio-Merkmale Ihres Tracks

Tip Tools von Drittanbietern können die Audio-Merkmale Ihres Tracks über die Spotify API abrufen. Suchen Sie nach Diensten, bei denen Sie eine Spotify-Track-URL eingeben können und die Ihnen die Merkmalswerte zurückgeben.

Worauf Sie achten sollten:

- Konsistente Merkmale im gesamten Katalog helfen dem Algorithmus, Ihre Musik zu gruppieren. Wenn Ihre Tracks bei Energie, Tempo und Valence stark schwanken, hat der Algorithmus Schwierigkeiten vorherzusagen, wer sie genießen wird.

- Merkmale, die zu Ihrer Zielgruppe passen, verbessern die Platzierung im Radio. Wenn Ihr Sound energiegeladen und tanzbar ist, erscheinen Ihre Tracks eher in Workout- und Party-Radiosendungen.

Das Intro-Problem

Die Audioanalyse untersucht den gesamten Track, aber das Hörverhalten wird stark von den ersten 30 Sekunden beeinflusst. Wenn Ihr Intro andere Eigenschaften als der Rest des Songs hat (ein leises Ambient-Intro vor einem lauten Drop), spiegeln die Audio-Merkmale möglicherweise nicht wider, was die Zuhörer zuerst erleben.

Dies kann zu einer Diskrepanz führen: Der Algorithmus empfiehlt Ihren Track aufgrund der Gesamtenergie, aber die Zuhörer überspringen ihn, weil das Intro nicht ihren Erwartungen entspricht. Die Optimierung Ihres Intros ist eine andere Fähigkeit als die Optimierung Ihres allgemeinen Audio-Profils.

Einschränkungen der Audioanalyse

Die Audioanalyse ist leistungsstark, hat aber blinde Flecken:

Kultureller Kontext fehlt. Der Algorithmus weiß, dass Ihr Track hohe Energie und ein Tempo von 128 BPM hat, aber er weiß nicht, dass der Text einen bestimmten kulturellen Moment referenziert oder dass der Produktionsstil eine bestimmte Ära hervorruft.

Ähnliche Klänge sind nicht dasselbe wie ähnliche Zielgruppen. Zwei Tracks können nahezu identische Audio-Merkmale aufweisen, aber völlig unterschiedliche Zuhörer ansprechen. Die Audioanalyse findet klangliche Nachbarn, aber keine Zielgruppen-Nachbarn.

Das Genre wird abgeleitet, nicht deklariert. Spotify verwendet die von Ihrem Distributor bereitgestellten Genre-Tags, aber die Audioanalyse kann diese außer Kraft setzen, wenn die klanglichen Eigenschaften nicht übereinstimmen. Ein Track, der als „Hip-Hop“ getaggt ist, aber nach Akustik-Folk klingt, wird stattdessen möglicherweise Folk-Zuhörern empfohlen.

Die Rolle von Audio im breiteren Algorithmus

Die Audioanalyse ist eine von drei Hauptdatenquellen, die der Spotify-Algorithmus verwendet:

| Data source | What it captures | Best for |

|---|---|---|

| Collaborative filtering | Hörverhalten über Benutzer hinweg | Zielgruppenüberschneidungen finden |

| Natural language processing | Songtexte, Playlist-Titel, Web-Erwähnungen | Kulturellen Kontext verstehen |

| Audio analysis | Klangliche Eigenschaften der Wellenform | Klanglich ähnliche Tracks finden |

Für etablierte Künstler dominiert das kollaborative Filtern. Für neue Künstler wiegt die Audioanalyse mehr, da noch keine Hörhistorie analysiert werden kann.

Das Ziel ist es, Musik mit klaren, konsistenten Audio-Merkmalen zu veröffentlichen und gleichzeitig eine engagierte Hörerschaft aufzubauen. Die Audioanalyse hilft bei der Entdeckung; Engagement-Signale bestimmen, ob Sie weiterhin empfohlen werden.