Quando Spotify deve trovare brani che suonano simili a ciò che stai ascoltando, non può fare affidamento solo su tag e metadati. Analizza l'audio grezzo stesso.

Questa guida spiega come Spotify estrae le caratteristiche audio dai file musicali, cosa significano tali caratteristiche e come influenzano la posizione dei tuoi brani nelle playlist algoritmiche.

Come funziona l'analisi audio su Spotify

Quando un brano viene caricato su Spotify tramite un distributore, passa attraverso una pipeline automatizzata di analisi audio. Il sistema elabora la forma d'onda grezza ed estrae decine di caratteristiche misurabili.

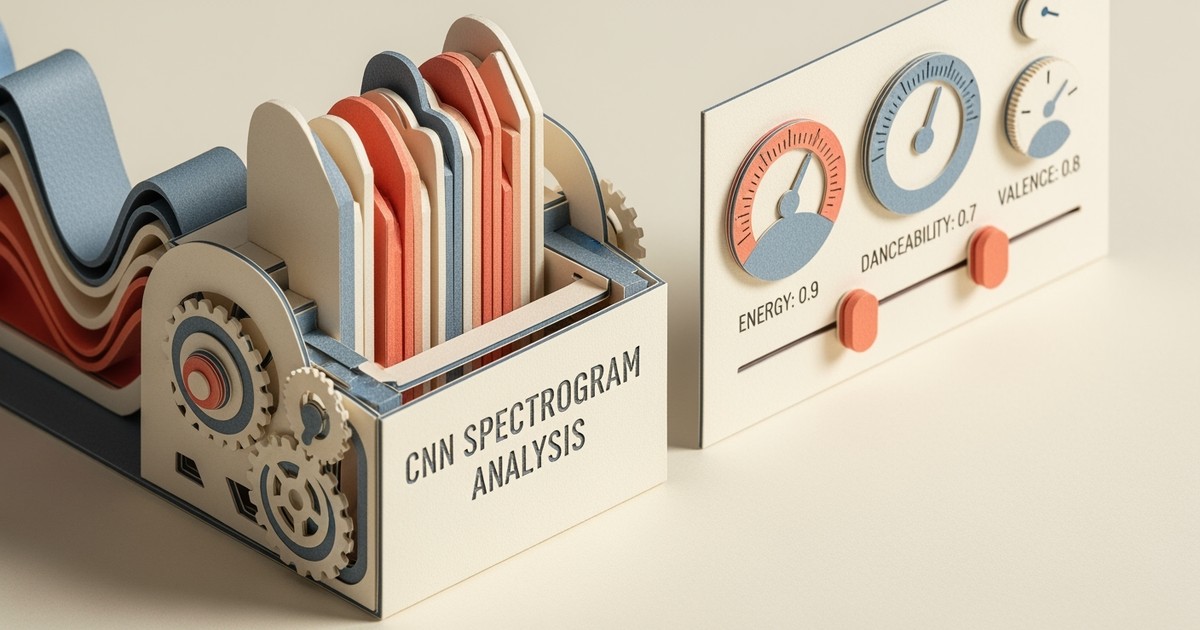

La tecnologia principale sono le reti neurali convoluzionali (CNN), lo stesso tipo di modelli di machine learning utilizzati per il riconoscimento delle immagini. Invece di analizzare i pixel, le CNN di Spotify analizzano gli spettrogrammi, che sono rappresentazioni visive delle frequenze sonore nel tempo.

La CNN impara a rilevare schemi in questi spettrogrammi: battiti di batteria forti e sintetizzatori suggeriscono musica elettronica o dance; modelli di chitarra acustica tenui indicano generi folk o cantautorato; strutture armoniche complesse potrebbero segnalare jazz o musica classica.

Le caratteristiche audio estratte da Spotify

L'API di Spotify espone 13 caratteristiche audio per ogni brano. Questi sono i blocchi costitutivi che l'algoritmo utilizza per misurare la somiglianza sonora.

Caratteristiche di ritmo e tempo

| Caratteristica | Definizione | Intervallo |

|---|---|---|

tempo |

Battiti per minuto (BPM) stimati | 0-250 |

time_signature |

Battiti per misura (3/4, 4/4, ecc.) | 1-7 |

danceability |

Quanto è adatto al ballo in base a tempo, stabilità ritmica, forza del beat | 0.0-1.0 |

La Danceability non è solo il tempo. Un brano a 120 BPM con ritmi irregolari ottiene un punteggio inferiore rispetto a un brano a 100 BPM con un groove costante.

Caratteristiche di energia e intensità

| Caratteristica | Definizione | Intervallo |

|---|---|---|

energy |

Misura percettiva di intensità e attività | 0.0-1.0 |

loudness |

Volume complessivo in decibel (dB) | -60 a 0 dB |

L'Energy combina più segnali: gamma dinamica, volume percepito, timbro, tasso di inizio (quanto spesso iniziano nuovi suoni) ed entropia generale. Il death metal ottiene un punteggio alto; un preludio di Bach ottiene un punteggio basso.

Caratteristiche tonali

| Caratteristica | Definizione | Intervallo |

|---|---|---|

key |

Il centro tonale del brano | 0-11 (Do=0, Do#=1, ecc.) |

mode |

Maggiore (1) o minore (0) | 0 o 1 |

Queste caratteristiche aiutano l'algoritmo a raggruppare brani con strutture armoniche compatibili per transizioni fluide in Radio e Autoplay.

Caratteristiche di umore e carattere

| Caratteristica | Definizione | Intervallo |

|---|---|---|

valence |

Positività musicale (felice vs triste) | 0.0-1.0 |

acousticness |

Fiducia che il brano sia acustico | 0.0-1.0 |

instrumentalness |

Prevede se il brano non ha voci | 0.0-1.0 |

speechiness |

Presenza di parole parlate | 0.0-1.0 |

liveness |

Probabilità che il brano sia stato eseguito dal vivo | 0.0-1.0 |

La Valence è particolarmente importante per i consigli basati sull'umore. Un brano ad alta valence (0.8+) suona allegro o euforico. Un brano a bassa valence (0.2 o inferiore) suona triste, malinconico o arrabbiato.

Come le caratteristiche audio influenzano i consigli

L'analisi audio risolve il problema dell'avvio a freddo (cold start). Quando un nuovo artista carica il suo primo brano, non ha una cronologia di ascolto o dati di filtraggio collaborativo. Ma le caratteristiche audio sono disponibili immediatamente.

Ecco come ogni superficie algoritmica utilizza l'analisi audio:

Radio e Autoplay

Quando Radio genera una coda basata su un brano seme, la somiglianza audio è il segnale principale. L'algoritmo trova brani con:

- Tempo simile (entro un intervallo ragionevole per transizioni fluide)

- Livello di energia (per mantenere l'intensità della sessione)

- Tonalità e modo (per la compatibilità armonica)

- Valence (per preservare il tono emotivo)

Questo è il motivo per cui una stazione Radio seminata da un brano elettronico ad alta energia non inserirà improvvisamente una lenta ballata acustica, anche se entrambe le canzoni condividono tag di genere.

Discover Weekly

Discover Weekly utilizza principalmente il filtraggio collaborativo, ma l'analisi audio funge da criterio di spareggio. Quando più brani candidati hanno punteggi di sovrapposizione di ascolto simili, l'algoritmo privilegia quelli con caratteristiche audio più vicine al tuo profilo di gusto esistente.

Cosa possono imparare gli artisti dalle caratteristiche audio

Non puoi controllare direttamente come Spotify analizza il tuo audio, ma comprendere queste caratteristiche ti aiuta a interpretare come l'algoritmo percepisce la tua musica.

Controllo delle caratteristiche audio del tuo brano

Tip Strumenti di terze parti possono recuperare le caratteristiche audio del tuo brano dall'API di Spotify. Cerca servizi che ti permettano di inserire un URL di un brano Spotify e restituiscano i valori delle caratteristiche.

Cosa cercare:

- Caratteristiche coerenti in tutto il catalogo aiutano l'algoritmo a raggruppare la tua musica. Se i tuoi brani variano selvaggiamente in energia, tempo e valence, all'algoritmo è più difficile prevedere chi li apprezzerà.

- Caratteristiche che corrispondono al tuo pubblico di destinazione migliorano il posizionamento su Radio. Se il tuo suono è ad alta energia e ballabile, è più probabile che i tuoi brani compaiano nelle sessioni Radio per allenamento e feste.

Il problema dell'introduzione (intro problem)

L'analisi audio esamina l'intero brano, ma il comportamento degli ascoltatori è fortemente influenzato dai primi 30 secondi. Se la tua introduzione ha caratteristiche diverse dal resto della canzone (un'introduzione acustica tranquilla prima di un drop forte), le caratteristiche audio potrebbero non riflettere ciò che gli ascoltatori sperimentano per primi.

Questo può creare una discrepanza: l'algoritmo consiglia il tuo brano in base all'energia generale, ma gli ascoltatori lo saltano perché l'introduzione non corrisponde alle loro aspettative. Ottimizzare l'introduzione è un'abilità separata dall'ottimizzare il profilo audio generale.

Limitazioni dell'analisi audio

L'analisi audio è potente, ma ha dei punti ciechi:

Manca il contesto culturale. L'algoritmo conosce il tuo brano ad alta energia e con un tempo di 128 BPM, ma non sa che il testo fa riferimento a un momento culturale specifico o che lo stile di produzione evoca una particolare epoca.

Suoni simili non sono lo stesso che pubblico simile. Due brani possono avere caratteristiche audio quasi identiche ma attrarre ascoltatori completamente diversi. L'analisi audio trova vicini sonori, non vicini di pubblico.

Il genere è dedotto, non dichiarato. Spotify utilizza i tag di genere forniti dal tuo distributore, ma l'analisi audio può sovrascriverli se le caratteristiche sonore non corrispondono. Un brano etichettato come "hip-hop" che suona come folk acustico potrebbe essere consigliato agli ascoltatori folk.

Il ruolo dell'audio nell'algoritmo più ampio

L'analisi audio è una delle tre fonti di dati principali utilizzate dall'algoritmo di Spotify:

| Fonte dati | Cosa cattura | Ideale per |

|---|---|---|

| Filtraggio collaborativo | Modelli di ascolto tra utenti | Trovare sovrapposizioni di pubblico |

| Elaborazione del linguaggio naturale | Testi, titoli di playlist, menzioni web | Comprendere il contesto culturale |

| Analisi audio | Caratteristiche sonore della forma d'onda | Trovare brani sonicamente simili |

Per gli artisti affermati, il filtraggio collaborativo è predominante. Per i nuovi artisti, l'analisi audio ha più peso perché non ci sono dati di ascolto da analizzare.

L'obiettivo è pubblicare musica con caratteristiche audio chiare e coerenti costruendo al contempo una base di ascoltatori coinvolta. L'analisi audio ti fa scoprire; i segnali di coinvolgimento determinano se continuerai a essere consigliato.