Como a análise de áudio funciona no Spotify

Quando uma faixa é enviada ao Spotify por meio de uma distribuidora, ela passa por um processo automatizado de análise de áudio. O sistema processa a forma de onda bruta e extrai dezenas de características mensuráveis.

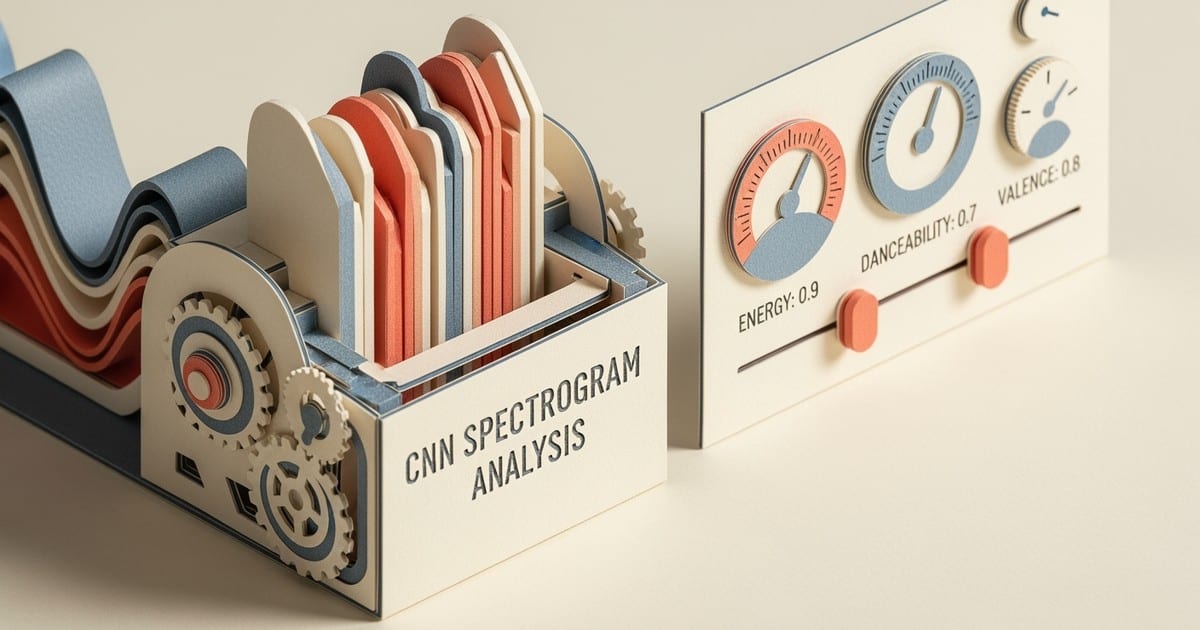

A tecnologia central são as redes neurais convolucionais (CNNs), o mesmo tipo de modelo de aprendizado de máquina usado para reconhecimento de imagem. Em vez de analisar pixels, as CNNs do Spotify analisam espectrogramas, que são representações visuais das frequências sonoras ao longo do tempo.

A CNN aprende a detectar padrões nesses espectrogramas: batidas fortes de bateria e sintetizadores sugerem música eletrônica ou dance; padrões suaves de violão indicam gêneros folk ou de cantores-compositores; estruturas harmônicas complexas podem sinalizar jazz ou música clássica.

As características de áudio que o Spotify extrai

A API do Spotify expõe 13 recursos de áudio para cada faixa. Esses são os blocos de construção que o algoritmo usa para medir a similaridade sonora.

Características de ritmo e andamento

| Recurso | Definição | Intervalo |

|---|---|---|

tempo |

Batidas por minuto (BPM) estimadas | 0-250 |

time_signature |

Batidas por compasso (3/4, 4/4, etc.) | 1-7 |

danceability |

Adequação para dançar com base no andamento, estabilidade do ritmo e força da batida | 0.0-1.0 |

Danceability não é apenas andamento. Uma faixa de 120 BPM com ritmos irregulares tem uma pontuação menor do que uma faixa de 100 BPM com um groove constante.

Características de energia e intensidade

| Recurso | Definição | Intervalo |

|---|---|---|

energy |

Medida perceptiva de intensidade e atividade | 0.0-1.0 |

loudness |

Volume geral em decibéis (dB) | -60 a 0 dB |

Energy combina múltiplos sinais: faixa dinâmica, volume percebido, timbre, taxa de início (frequência com que novos sons começam) e entropia geral. Death metal tem pontuação alta; um prelúdio de Bach tem pontuação baixa.

Características tonais

| Recurso | Definição | Intervalo |

|---|---|---|

key |

O centro tonal da faixa | 0-11 (C=0, C#=1, etc.) |

mode |

Maior (1) ou menor (0) | 0 ou 1 |

Esses recursos ajudam o algoritmo a agrupar faixas com estruturas harmônicas compatíveis para transições suaves no Radio e na Autoplay.

Características de humor e caráter

| Recurso | Definição | Intervalo |

|---|---|---|

valence |

Positividade musical (feliz vs triste) | 0.0-1.0 |

acousticness |

Confiança de que a faixa é acústica | 0.0-1.0 |

instrumentalness |

Prevê se a faixa não possui vocais | 0.0-1.0 |

speechiness |

Presença de palavras faladas | 0.0-1.0 |

liveness |

Probabilidade de a faixa ter sido performada ao vivo | 0.0-1.0 |

Valence é particularmente importante para recomendações baseadas no humor. Uma faixa com alta valência (0.8+) soa alegre ou eufórica. Uma faixa com baixa valência (0.2 ou menos) soa triste, melancólica ou irritada.

Como as características de áudio influenciam as recomendações

A análise de áudio resolve o problema de início a frio. Quando um novo artista envia sua primeira faixa, ele não tem histórico de audição ou dados de filtragem colaborativa. Mas as características de áudio estão disponíveis imediatamente.

Veja como cada superfície algorítmica usa a análise de áudio:

Radio e Autoplay

Quando o Radio gera uma fila com base em uma faixa semente, a similaridade de áudio é o sinal principal. O algoritmo encontra faixas com similaridades em:

- Andamento (dentro de uma faixa razoável para transições suaves)

- Nível de energia (para manter a intensidade da sessão)

- Tom e modo (para compatibilidade harmônica)

- Valência (para preservar o tom emocional)

É por isso que uma estação de Radio iniciada a partir de uma faixa eletrônica de alta energia não inserirá repentinamente uma balada acústica lenta, mesmo que ambas as músicas compartilhem tags de gênero.

Descobertas da Semana

O Discover Weekly utiliza principalmente filtragem colaborativa, mas a análise de áudio atua como um critério de desempate. Quando várias faixas candidatas possuem pontuações de sobreposição de audição semelhantes, o algoritmo favorece aquelas com características de áudio mais próximas do seu perfil de gosto existente.

O que os artistas podem aprender com as características de áudio

Você não pode controlar diretamente como o Spotify analisa seu áudio, mas entender essas características ajuda a interpretar como o algoritmo percebe sua música.

Verificando as características de áudio da sua faixa

Tip Ferramentas de terceiros podem extrair as características de áudio da sua faixa a partir da API do Spotify. Procure serviços que permitam inserir uma URL de faixa do Spotify e retornar os valores das características.

O que observar:

- Características consistentes em todo o seu catálogo ajudam o algoritmo a agrupar sua música. Se suas faixas variam muito em energia, andamento e valência, o algoritmo tem mais dificuldade em prever quem irá apreciá-las.

- Características que correspondem ao seu público-alvo melhoram o posicionamento no Radio. Se o seu som é de alta energia e dançante, suas faixas têm mais probabilidade de aparecer em sessões de Radio voltadas para treino e festas.

O problema da introdução

A análise de áudio examina a faixa completa, mas o comportamento do ouvinte é fortemente influenciado pelos primeiros 30 segundos. Se sua introdução tiver características diferentes do restante da música (uma introdução ambiente silenciosa antes de um drop alto), as características de áudio podem não refletir o que os ouvintes experimentam primeiro.

Isso pode criar uma incompatibilidade: o algoritmo recomenda sua faixa com base na energia geral, mas os ouvintes pulam porque a introdução não corresponde às suas expectativas. Otimizar sua introdução é uma habilidade separada de otimizar seu perfil de áudio geral.

Limitações da análise de áudio

A análise de áudio é poderosa, mas tem pontos cegos:

O contexto cultural está ausente. O algoritmo sabe que sua faixa tem alta energia e um andamento de 128 BPM, mas não sabe que a letra faz referência a um momento cultural específico ou que o estilo de produção evoca uma era particular.

Sons semelhantes não são o mesmo que públicos semelhantes. Duas faixas podem ter características de áudio quase idênticas, mas atrair ouvintes completamente diferentes. A análise de áudio encontra vizinhos sonoros, não vizinhos de público.

O gênero é inferido, não declarado. O Spotify usa as tags de gênero fornecidas pela sua distribuidora, mas a análise de áudio pode substituí-las se as características sonoras não corresponderem. Uma faixa marcada como "hip-hop" que soa como folk acústico pode acabar sendo recomendada para ouvintes de folk.

O papel do áudio no algoritmo mais amplo

A análise de áudio é uma das três principais fontes de dados que o algoritmo do Spotify usa:

| Fonte de dados | O que captura | Melhor para |

|---|---|---|

| Filtragem colaborativa | Padrões de audição entre usuários | Encontrar sobreposição de público |

| Processamento de linguagem natural | Letras, títulos de playlists, menções na web | Entender o contexto cultural |

| Análise de áudio | Características sonoras da forma de onda | Encontrar faixas sonoramente semelhantes |

Para artistas estabelecidos, a filtragem colaborativa domina. Para novos artistas, a análise de áudio tem mais peso porque não há histórico de audição para analisar.

O objetivo é lançar música com características de áudio claras e consistentes enquanto constrói uma base de ouvintes engajados. A análise de áudio faz com que você seja descoberto; os sinais de engajamento determinam se você continuará sendo recomendado.